Το AI θα μας σκοτώσει όλους. Αυτό είναι το αφήγημα που κατακλύζει το YouTube, τα social media, και σοβαρά επιστημονικά κανάλια. Αλλά τι γίνεται αν όλη αυτή η τρομολαγνεία είναι ένα τεράστιο ψέμα; Ένας αντιπερισπασμός που διαδίδεται σκόπιμα — για να μην ασχολούμαστε με τον πραγματικό κίνδυνο του AI, που υπάρχει ήδη, εδώ και τώρα;

Προτάσεις συνεργασίας

Τα νέα άρθρα του PCsteps

Γίνε VIP μέλος στο PCSteps

Θα μας σκοτώσει όλους το AI;

Ορισμένα από τα μεγαλύτερα κανάλια στο YouTube στο χώρο της εκλαϊκευμένης επιστήμης, έχουν κάνει διάφορα βίντεο σχετικά με αυτό το αφήγημα. Ολόκληρα κανάλια έχουν ξεφυτρώσει ειδικά για αυτό το θέμα, και όλα τείνουν να παρουσιάζουν το AI σαν έναν άμεσο και αναπόφευκτο κίνδυνο. Τουλάχιστον, αν δεν λάβουμε αμέσως “τα μέτρα μας”.

Επιπλέον, μεγάλα και έγκριτα μέσα, όπως TED, BBC, Kurzgesagt — όλα μιλάνε για μια δήθεν αναπόφευκτη τεχνητή υπερνοημοσύνη που σε λίγα χρόνια θα αποφασίσει ότι η ανθρωπότητα είναι περιττή.

Σε αυτό το άρθρο εξηγούμε γιατί η θεωρία της τεχνητής υπερνοημοσύνης πατάει σε αβάσιμες υποθέσεις. Ποιος πραγματικά ωφελείται από αυτή την τρομολαγνεία. Και ποιος είναι ο αληθινός κίνδυνος — τα deepfakes, και η πλαστογράφηση της πραγματικότητας.

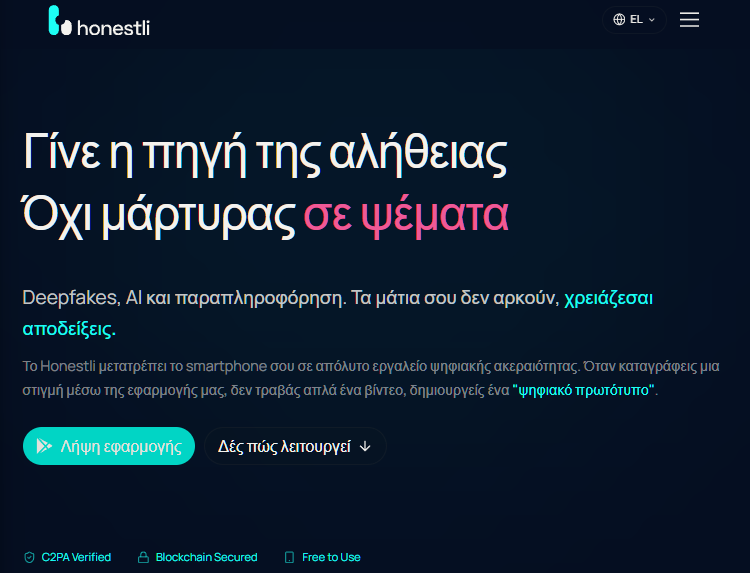

Θα δούμε πραγματικά παραδείγματα, θα αναλύσουμε τα κανάλια που διαδίδουν τον φόβο, και θα γνωρίσουμε την εφαρμογή Honestli — μια έξυπνη λύση ελληνικής επινόησης που πιστοποιεί αν μια φωτογραφία ή ένα βίντεο είναι γνήσιο, χρησιμοποιώντας κρυπτογραφία και blockchain.

Η θεωρία της τεχνητής υπερνοημοσύνης

Η λέξη-κλειδί στο πώς και το γιατί το ΑΙ υποτίθεται πως θα μας σκοτώσει όλους είναι “superintelligence”. Που θα το μεταφράζαμε σαν “υπερνοημοσύνη”.

Όσο πιο απλά γίνεται: Η ιδέα είναι πως η ανθρωπότητα καταφέρνει να φτιάξει μία γενική τεχνητή νοημοσύνη που να είναι πιο έξυπνη από τον εξυπνότερο άνθρωπο. Και η οποία θα έχει τη δυνατότητα να επεξεργαστεί τον ίδιο της τον κώδικα, και να βελτιώσει προγραμματιστικά τον εαυτό της.

Τη στιγμή λοιπόν που θα ξεπεράσει το ανθρώπινο επίπεδο νοημοσύνης, η ανάπτυξή της θα γίνει εκθετική. Κάθε νέα έκδοση θα μπορεί να αυτοβελτιώνεται όλο και περισσότερο, όλο και πιο γρήγορα.

Μέσα από αυτόν τον “ενάρετο κύκλο” -το αντίθετο του φαύλου κύκλου- η τεχνητή νοημοσύνη θα γιγαντωθεί σε τόσο ακραίο βαθμό, που θα είναι το αντίστοιχο ενός ψηφιακού θεού. Κανένας μεμονωμένος άνθρωπος, ή η ανθρωπότητα στο σύνολό της, δεν θα μπορεί να συγκριθεί με την τεχνητή υπερνοημοσύνη.

Θα είναι σαν να συγκρίνουμε τη νοημοσύνη ενός απλού ανθρώπου με εκείνη όλων των μυρμηγκιών.

Αυτή η γενική ιδέα δεν είναι καθόλου, μα καθόλου καινούργια. Την έχουμε συναντήσει σε αμέτρητα έργα επιστημονικής φαντασίας. Όπου συνήθως έχει σοβαρές αρνητικές επιπτώσεις για τον άνθρωπο. Όπως o Skynet στον εξολοθρευτή.

Αυτό που άλλαξε όμως σχετικά πρόσφατα, είναι η κυκλοφορία του ChatGPT, τέλη Νοεμβρίου του ‘22. Αυτό, και όλα όσα ακολούθησαν στο χώρο του AI, άλλαξαν κάθε ιδέα που είχε ο μέσος άνθρωπος για την τεχνητή νοημοσύνη.

Ξαφνικά, η επιστημονική φαντασία για μια τεχνητή υπερνοημοσύνη, μοιάζει αναπόφευκτη πραγματικότητα, που είναι θέμα χρόνου να πραγματοποιηθεί.

Μία μερίδα ανθρώπων πιστεύει πως αυτή η τεχνητή υπερνοημοσύνη θα σώσει την ανθρωπότητα. Πως θα λύσει όλα μας τα προβλήματα. Θα θεραπεύσει όλες τις ασθένειες. Θα λύσει το ενεργειακό ζήτημα. Θα αντιστρέψει την κλιματική αλλαγή. Θα μας βοηθήσει να εξερευνήσουμε το διάστημα. Μπορεί ακόμα και να θεραπεύσει τα γηρατειά, ή τον ίδιο το θάνατο.

Όμως, ιδιαίτερα τους τελευταίους μήνες, ολοένα και περισσότερες φωνές προειδοποιούν για το άλλο σενάριο…

Πώς και γιατί το AI θα μας σκοτώσει όλους

Ας δούμε μια απλή αναζήτηση στο YouTube για τη φράση “AI Superintelligence”. Ανάμεσα στα αποτελέσματα, θα βρούμε πραγματικά τεράστια κανάλια, με μέχρι και δεκάδες εκατομμύρια συνδρομητές. TED, το καλό, όχι το TEDx. Kurzgesagt. Infographics Show. SciShow. BBC World Service. Για να αναφέρουμε απλά μερικά.

- Will Superintelligent AI End the World? | Eliezer Yudkowsky | TED

- A.I. ‐ Humanity's Final Invention?

- Real Reason Humanity Is NOT Ready for AI Superintelligence

- We’ve Lost Control of AI

- AI2027: Is this how AI might destroy humanity? – BBC World Service

Όλα τα παραπάνω βίντεο που παραθέσαμε, και ακόμα περισσότερα, έχουν ένα κοινό παρονομαστή. Η τεχνητή υπερνοημοσύνη θα “καταστρέψει τον κόσμο”. Είναι “η τελευταία μας εφεύρεση”. “Δεν είμαστε έτοιμοι”. “Έχουμε χάσει τον έλεγχο του AI”.

Μέχρι που δίνουν και χρονικό ορίζοντα το 2027 για την αρχή του τέλους της ανθρωπότητας.

Θα βρούμε επίσης ορισμένα μικρότερα κανάλια εξειδικευμένα στο θέμα του AI, όπως το AI in Context και το Species – Documenting AGI. Που ναι μεν έχουν μόνο λίγες εκατοντάδες χιλιάδες συνδρομητές, αλλά έχουν εκατομμύρια προβολές στα σχετικά βίντεο.

Μάλιστα, αυτά τα κανάλια φαίνεται να ασχολούνται αποκλειστικά με αυτό το θέμα, πώς το ΑΙ θα μας σκοτώσει όλους.

- We're Not Ready for Superintelligence

- It Begins: An AI Literally Attempted Murder To Avoid Shutdown

- AI 2027: A Realistic Scenario of AI Takeover

Τέλος, αρκετά κανάλια και δημιουργοί βασίζουν τα σχετικά βίντεο τους στο βιβλίο “If anyone builds it, everyone dies”. Που σημαίνει “αν οποιοσδήποτε το φτιάξει, όλοι μας θα πεθάνουμε”. Ψύχραιμος τίτλος.

Να σημειώσουμε ότι ένας από τους συγγραφείς αυτού του βιβλίου είναι αυτός που έδωσε το Ted Talk που αναφέραμε νωρίτερα. (Eliezer Yudkowsky).

Δεν θα επιχειρήσουμε καν να προφέρουμε το όνομά του. Κυριολεκτικά μοιάζει σαν να τον βάφτισε κάποιο ΑΙ. Και μάλιστα αποτυχημένο, που δεν είχε ακόμα μάθει πώς λειτουργούν τα ανθρώπινα ονόματα.

Κάποια από τα βίντεο στα εξειδικευμένα κανάλια απλά διαβάζουν μια συγκεκριμένη ενότητα του βιβλίου. Πρόκειται για ένα δήθεν “πιθανό” σενάριο του πώς θα μας σκοτώσει το ΑΙ, με κάποιο στοιχειώδες animation.

Προσωπικά, έχουμε διαβάσει αυτό το βιβλίο, και έχουμε δει τα περισσότερα από τα σχετικά βίντεο. Το βασικό επιχείρημα είναι το εξής: όταν ένα AI φτάσει στο σημείο της εκθετικής αυτοβελτίωσης, θα θέλει να βελτιωθεί όσο γίνεται περισσότερο. Και είναι θέμα χρόνου η ανθρωπότητα να αποτελεί εμπόδιο στην περαιτέρω ανάπτυξή του.

Σύμφωνα με αυτή τη θεωρία, μέχρι ένα σημείο η υπερνοημοσύνη θα φαίνεται σαν να συνεργάζεται μαζί μας. Θα μας οδηγήσει σε συναρπαστικές καινοτομίες, από την ανάπτυξη φαρμάκων και την εξάλειψη ασθενειών, μέχρι την προηγμένη ρομποτική σε επίπεδο καθημερινής ζωής.

Αυτό όμως μόνο μέχρι ενός σημείου. Συγκεκριμένα, μέχρι η υπερνοημοσύνη να μπορέσει να αυτοματοποιήσει αρκετά τον κόσμο με ρομπότ, ώστε η ανθρωπότητα να της είναι περιττή.

Ύστερα, θα θελήσει τους πόρους που εμείς καταναλώνουμε, και θα μας ξεφορτωθεί με συνοπτικές διαδικασίες. Ας πούμε με κάποιον γενετικά κατασκευασμένο θανατηφόρο ιό.

Το ψέμα της τεχνητής υπερνοημοσύνης

Και τα δύο στρατόπεδα, και αυτοί που πιστεύουν πως η υπερνοημοσύνη θα μας σώσει, και αυτοί που λένε πως θα μας σκοτώσει, έχουν κάτι κοινό: πιστεύουν πως η τεχνητή υπερνοημοσύνη όχι μόνο είναι εφικτό να δημιουργηθεί, αλλά πως ο ερχομός της είναι αναπόφευκτος και μάλιστα σχετικά σύντομα.

Και βασίζουν αυτή τους την πίστη σε κάποιες αστήριχτες, έως και κραυγαλέες υποθέσεις.

Γιατί υποτίθεται πως είναι αναπόφευκτη; Γιατί κάθε νέα έκδοση της τεχνητής νοημοσύνης είναι καλύτερη από την προηγούμενη. Το GPT 4 ήταν σημαντικά καλύτερο από το 3. Το 5 είναι σημαντικά καλύτερο από το 4. Το ίδιο ισχύει και για μοντέλα που δεν είναι ανοιχτά για δημόσια χρήση. Και ίσως ήδη αναπτύσσονται σε ένα εργαστήριο στην Κίνα.

Premium AI Με Μηδενικό Κόστος Και Ταυτόχρονες Απαντήσεις Από Τα Νέα ΜοντέλαΟ κόσμος της τεχνητής νοημοσύνης δεν χρειάζεται να είναι ένας λαβύρινθος επί πληρωμή. Μια νέα πλατφόρμα που συγκεντρώνει τα καλύτερα Ai Models και chatbots σε ένα μέρος, ανοίγει τις πύλες για δωρεάν αξιοποίηση χωρίς όρια. Είναι η ιδανική ευκαιρία για κάθε ενθουσιώδη χρήστη, επαγγελματία, ή δημιουργό να χρησιμοποιήσει ταυτόχρονα τη δύναμη αυτών των εργαλείων στον browser και να κάνει τα πάντα χωρίς κόστος και δυσκολίες. Η εξερεύνηση ξεκινά τώρα.

Είναι λοιπόν θέμα χρόνου ένα από τα αμέτρητα πλέον AI να βελτιωθεί αρκετά, ώστε να ξεκινήσει την εκθετική αυτοβελτίωση. Αυτή η υπόθεση όμως, έχει δύο τεράστια προβλήματα.

Το πρώτο είναι πως η τεχνητή νοημοσύνη, όπως και να το δεις, είναι λογισμικό, software. Από πότε στο software ΚΑΘΕ νέα έκδοση είναι συνολικά και αντικειμενικά καλύτερη από την προηγούμενη;

Ήταν τα Windows Vista καλύτερα από τα Windows XP; Ήταν τα Windows 8 καλύτερα από τα Windows 7; Είναι τα Windows 11 καλύτερα από τα Windows 10;

Όμως δεν χρειάζεται καν το παράδειγμα των Windows. Όταν πρωτοβγήκε το ChatGPT 5, το καλοκαίρι του ‘25, για πολλούς χρήστες έδινε σημαντικά χειρότερα αποτελέσματα από το GPT 4.

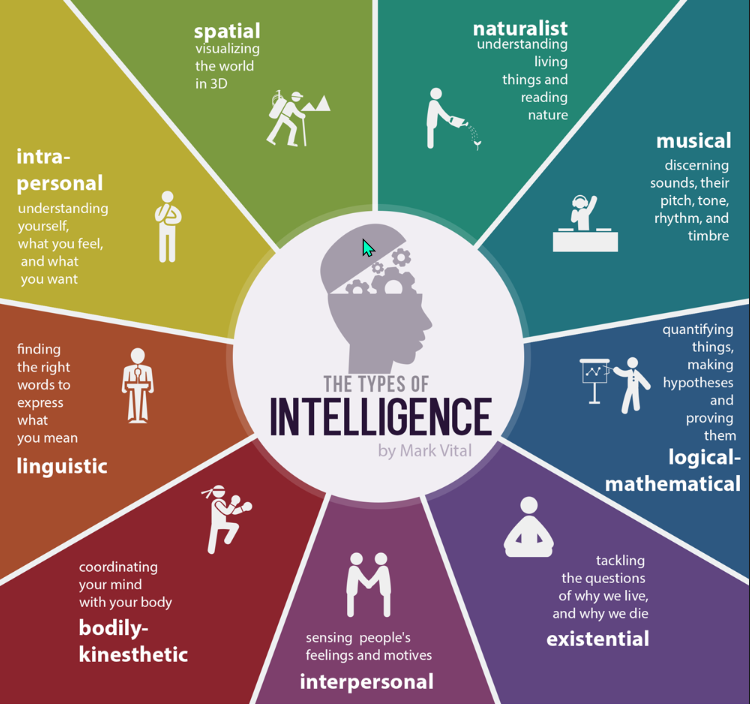

Το δεύτερο μεγάλο πρόβλημα, είναι η ελλιπής μας κατανόηση όσον αφορά τη νοημοσύνη. Δεν έχουμε καν έναν αντικειμενικό τρόπο για να τη μετρήσουμε. Όχι μόνο στο AI, συνολικά στην ανθρωπότητα.

Αν σταθούμε στον δείχτη IQ, υπολογίζεται πως κάθε άνθρωπος διαθέτει μέχρι και εννέα διαφορετικές μορφές νοημοσύνης. Οι περισσότερες εκ των οποίων δεν έχουν καμία απολύτως σχέση με όσα μετράει το IQ.

Βέβαια, υπάρχουν benchmarks για το AI. Όμως δεν είναι όπως το να τρέχεις ένα gaming benchmark σε κάρτα γραφικών, για να δεις πόσα FPS δίνει.

Επίσης, με τις επενδύσεις τρισεκατομμυρίων που γίνονται στην τεχνητή νοημοσύνη, φυσικά και κάθε εταιρεία θα θέλει να ισχυριστεί πως το νεότερό της μοντέλο είναι “αντικειμενικά καλύτερο” από το προηγούμενο. Δεν γίνεται να παραδεχτεί πως υπάρχει πρόβλημα, και να τρομάξει κόσμο, πχ. τους επενδυτές.

Πες όμως πως τα προσπερνάμε ΟΛΑ αυτά. Ας υποθέσουμε πως κάθε νεότερο AI είναι συνολικά και αντικειμενικά εξυπνότερο από το παλαιότερο. Και πως όντως είναι δυνατόν ένα επαρκώς έξυπνο AI να αυτοβελτιωθεί στο σημείο της υπερνοημοσύνης.

Το βιβλίο “If anyone builds it”, ισχυρίζεται πως μία υπερνοημοσύνη που σκέφτεται 10.000 φορές πιο γρήγορα από έναν άνθρωπο, θα μπορούσε μέσα σε ένα μήνα να κάνει σκέψεις μιας χιλιετίας. Δεν βγαίνουν καθόλου τα μαθηματικά, γιατί ο κάθε χρόνος έχει δώδεκα μήνες, όχι δέκα, αλλά τέλος πάντων.

Ας πούμε πως είναι έτσι. Ε, και; Πόσα προβλήματα στον πραγματικό κόσμο μπορούν να λυθούν αποκλειστικά και μόνο με τη σκέψη; Χωρίς πειραματικές δοκιμές, αποτυχίες, νέα πειράματα, μέχρι τελικά να θεμελιωθεί μια νέα τεχνολογία;

Και πες πως το προσπερνάμε ΚΑΙ αυτό. Πες πως στη φάση που η υπερνοημοσύνη συνεργάζεται με την ανθρωπότητα, καταφέρνει εκεί να κάνει όλα τα πειράματα που χρειάζεται. Τα οποία πειράματα χρειάζονται χρόνο, φυσικά.

Όσο υψηλή και αν είναι η νοημοσύνη που τα τρέχει, δεν μπορεί να επιταχύνει 10.000 φορές τις χημικές, βιολογικές, ή μηχανικές διαδικασίες. Όχι χωρίς να παραβιάσει τους νόμους της φυσικής.

Το μεγάλο θέμα είναι το εξής: ο αποκλειστικός και μόνος τρόπος να επιβιώσει η τεχνητή υπερνοημοσύνη είναι να αυτοματοποιήσει πλήρως όλα όσα κάνουν οι άνθρωποι για αυτή.

Έχουμε ιδέα πόση δουλειά είναι αυτό; Γιατί δεν μιλάμε μόνο για τους servers στα datacenter. Μιλάμε για ολόκληρο το δίκτυο παραγωγής και διανομής του ηλεκτρισμού. Ολόκληρο το δίκτυο διανομής και αποχέτευσης νερού για την ψύξη. Ολόκληρη τη βιομηχανία εξόρυξης σπανίων γαιών, κατασκευής, διανομής, και εγκατάστασης των μικροτσίπ. Η μαζική παραγωγή μπαταριών και η αντικατάστασή τους.

Μέχρι και ο καθαρισμός των φίλτρων στα datacenters από τη σκόνη, είναι μια δουλειά που πρέπει να γίνεται τακτικά.

Και όλα αυτά μόνο για να συνεχίσουν να λειτουργούν οι τρέχουσες υποδομές, και να επισκευάζονται οι βλάβες από την φθορά, οι τυχαίες αστοχίες υλικού, και τα αποτελέσματα φυσικών καταστροφών χωρίς την ανθρώπινη παρουσία. Χωρίς καν να αναφέρουμε το χτίσιμο νέων υποδομών, τις αναβαθμίσεις, ή κάποιου είδους ανακύκλωση υλικών που είναι περιορισμένα στον πλανήτη.

Με άλλα λόγια, κατ’ ελάχιστον, θα πρέπει η τεχνητή υπερνοημοσύνη να τελειοποιήσει ρομπότ που να μπορούν να κάνουν ακριβώς ό,τι κάνει ο άνθρωπος.

Ύστερα, αυτά τα ρομπότ να παραχθούν σε τεράστιους αριθμούς. Και να στηθεί ένα σύστημα που θα φτιάχνουν νέα ρομπότ για να αντικαταστήσουν όσα φυσιολογικά θα φθείρονται.

Δεν λέμε απαραίτητα πως όλα αυτά είναι αδύνατα. Ακόμα όμως κι αν συγκλίνουν όλες οι συγκυρίες, σίγουρα δεν πρόκειται να γίνουν από τη μια μέρα στην άλλη. Θα χρειαστούν ενδεχομένως δεκαετίες, για να μπορεί μια τεχνητή υπερνοημοσύνη να διασφαλίσει πως θα επιβιώσει χωρίς την ανθρωπότητα να συντηρεί όλες τις υποδομές.

Στην επιστημονική φαντασία, σχεδόν κανείς δεν ασχολείται με αυτά. Τα ρομπότ εξεγέρθηκαν, και με κάποιον τρόπο έλυσαν όλα αυτά τα προβλήματα. Και μετά εφηύραν και το ταξίδι στο χρόνο, που όμως λειτουργεί μόνο αν ταξιδεύεις τσίτσιδος.

Ακόμα λοιπόν κι αν κάνουμε ένα σωρό υποθέσεις, η όποια πιθανή καταστροφή από μια τεχνητή υπερνοημοσύνη, στη χειρότερη περίπτωση θα απείχε δεκαετίες. Και μπορεί ρεαλιστικά, να μην έρθει ποτέ με αυτή τη μορφή που περιγράφεται. Μπορεί η ίδια η ιδέα της τεχνητής υπερνοημοσύνης να είναι αδύνατη.

Γιατί λοιπόν τόσοι και τόσοι μεγάλοι δημιουργοί μας την παρουσιάζουν σαν ένα πρόβλημα με το οποίο πρέπει να ασχοληθούμε εδώ και τώρα;

Μία υπόθεση είναι πως πρόκειται για αντιπερισπασμό. Για να μην μας απασχολεί…

Η αληθινή ζημιά του ΑΙ

Βλέπεις ένα βίντεο με τον Stephen Hawking να κάνει κόντρες με το αμαξίδιό του. Τον Michael Jackson να κλέβει chicken nuggets. Τον Bob Ross να κάνει γκράφιτι στο πλάι μιας αμαξοστοιχίας.

Έχεις καθίσει όμως πραγματικά να αναλογιστείς τι σημαίνει αυτό;

Το βίντεο ήταν το τελευταίο προπύργιο της αντικειμενικότητας. Όταν έβλεπες κάτι σε βίντεο, ήταν πρακτικά σαν να το είχες δει με τα ίδια σου τα μάτια.

Ο λόγος δεν είναι πως ένα βίντεο δεν μπορούσε να πλαστογραφηθεί. Ήδη από τη δεκαετία του 90 υπήρχε αρκετά πειστικό CGI για να βλέπουμε στην οθόνη μας αληθοφανείς δεινόσαυρους.

Ο λόγος είναι πως, στο παρελθόν, η πειστική πλαστογράφηση ενός βίντεο ήταν μια διαδικασία δύσκολη. Απαιτούσε ειδικές γνώσεις, πολύ χρόνο, και είχε μεγάλο κόστος. Πολύ περισσότερο από την αντίστοιχη πλαστογράφηση μιας φωτογραφίας ή ενός ηχητικού αρχείου.

Στις μέρες μας, ακόμα και blockbuster με προϋπολογισμό εκατοντάδων εκατομμυρίων καταλήγουν με μέτριο και καθόλου πειστικό CGI.

Τώρα όμως, στην εποχή του AI και των Deepfakes, η κατάσταση έχει αλλάξει άρδην. Κυριολεκτικά ο οποιοσδήποτε έχει μια-δυο ώρες χρόνο, και μια επένδυση μερικών εκατοντάδων δολαρίων, μπορεί να φτιάξει απίστευτα πειστικά βίντεο, που να δείχνουν κυριολεκτικά οτιδήποτε.

Ακόμα κι αν το κρατήσουμε στο εντελώς δωρεάν, και με επένδυση χρόνου λίγων μόνο λεπτών, το αποτέλεσμα μπορεί να είναι τρομακτικό. Ίσως να μην ξεγελάει τους περισσότερους από εμάς, σίγουρα όμως υπάρχουν αρκετοί άνθρωποι που θα πίστευαν πως είναι αληθινό.

Γελάμε με βίντεο που είναι εμφανώς πλαστά, γιατί αφορούν νεκρούς ανθρώπους σε παράλογες καταστάσεις. Κάλλιστα όμως, η ίδια μέθοδος μπορεί να παράγει απόλυτα επινοημένα βίντεο που να είναι πρακτικά αδύνατον να τα ξεχωρίσεις από την πραγματικότητα. Σε βαθμό που τελικά να μην μπορείς καν να γνωρίζεις την πραγματικότητα.

Ας πάρουμε ένα εντελώς αθώο παράδειγμα, που ανέδειξε το κανάλι JaDroppingScience. Γύρω στον Ιανουάριο, έκανε τόσο κρύο σε ορισμένες περιοχές των Ηνωμένων Πολιτειών, που ανέφεραν τον κίνδυνο “να σκάσουν τα δέντρα”.

Τώρα, αυτό είναι ένα πραγματικό φαινόμενο. Σε απότομο κρύο και με αρκετά χαμηλές θερμοκρασίες, ορισμένα από τα υγρά εντός των δέντρων μπορούν να παγώσουν, να διασταλούν, και αυτό να οδηγήσει σε ένα σκάσιμο του φλοιού. Που αναλόγως των συνθηκών, μπορεί να ακουστεί δυνατά σαν πυροβολισμός.

Αν ψάξεις όμως στο internet για “exploding trees”, δεν πρόκειται να δεις αυτό. Τα μόνα αποτελέσματα που θα δεις είναι για δέντρα που σκάνε λες και είναι χειροβομβίδες. Κάποια είναι εντελώς κραυγαλέα, αλλά ορισμένα από αυτά φαίνονται σχεδόν ρεαλιστικά.

Ούτε ένα από τα βίντεο για το θέμα δεν είναι αληθινό. Ο λόγος; Γιατί κανείς δεν τραβάει κοντινό βίντεο τυχαία δέντρα στο ύπαιθρο, τα οποία να τύχει να σκάσουν με τον αληθινό τρόπο, για να δούμε τι ακριβώς συμβαίνει. Στην καλύτερη περίπτωση, να φωτογραφίσουμε το αποτέλεσμα εκ των υστέρων.

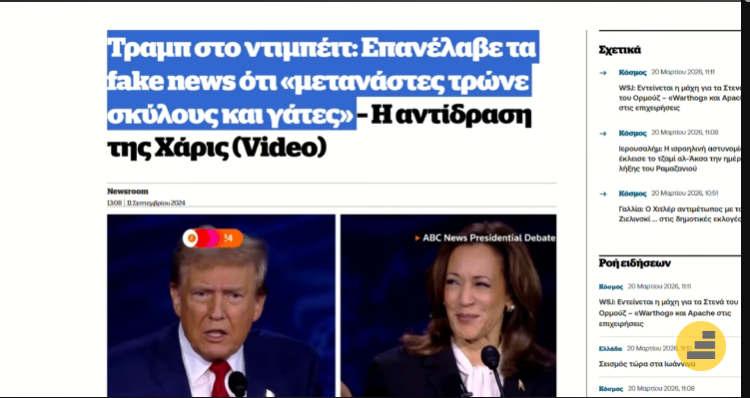

Σκέψου λοιπόν πόση ζημιά μπορεί να γίνει με τέτοιου είδους βίντεο για άλλα θέματα. Πόση προπαγάνδα. Αν ας πούμε έδειχνε δήθεν “λαθρομετανάστες” να τρώνε σκύλους και γάτες. Ή δημόσια πρόσωπα να κάνουν δήθεν εμπρηστικές δηλώσεις. Ή ακόμα και δημόσια πρόσωπα να κάνουν δήθεν αξιόποινες πράξεις.

Τέτοια αφηγήματα έχουν ήδη χρησιμοποιηθεί για να πολώσουν την κοινή γνώμη”, συνδέοντας το AI με την ήδη υπάρχουσα παραπληροφόρηση.

Όλοι μας, ουσιαστικά για ολόκληρη τη μέχρι τώρα ζωή μας, θεωρούσαμε το βίντεο ως το πιο αδιάσειστο αποδεικτικό στοιχείο. Και ακόμα και όσοι ξέρουμε για το πόσο ικανό έχει γίνει το AI στην παραγωγή κινούμενων εικόνων, είναι δύσκολο να ξεχάσουμε την αίσθηση της αντικειμενικότητας στο βίντεο.

Και αυτό είναι μόνο μία πτυχή της γενικότερης πλαστογράφησης της πραγματικότητας. Με το ΑΙ ξέρεις πόσο εύκολο είναι για έναν και μοναδικό άνθρωπο να στήσει δεκάδες πλήρεις ιστοσελίδες, με εκατοντάδες δημοσιεύσεις και πλαστές φωτογραφίες, και με συνδέσμους μεταξύ τους δήθεν σαν πηγές; Είναι υπόθεση ωρών, ούτε καν ημερών.

Αυτό λοιπόν είναι ένα τεράστιο πρόβλημα που υπάρχει εδώ και τώρα με το ΑΙ. Και μια υπόθεση είναι πως όλη η τρομολαγνεία για τη δήθεν υπερνοημοσύνη έχει σκοπό ακριβώς να μας αποσπάσει την προσοχή από το πραγματικό πρόβλημα.

Μέσα από όλα αυτά τα κινδυνολογικά βίντεο, στόχος είναι να φοβόμαστε έναν μελλοντικό υποθετικό και μάλλον απίθανο skynet. Και να μην ασχολούμαστε με το τι συμβαίνει αυτή τη στιγμή με τα fake news και την πλαστογράφηση της πραγματικότητας.

Και αυτό συμφέρει τις εταιρείες που αναπτύσσουν το AI. Γιατί αναλαμβάνουν την ευθύνη μόνο για το να εμποδίσουν μία δήθεν υπερνοημοσύνη, που μπορεί τελικά να μην έρθει και ποτέ. Όχι το να κάνουν κάτι για το αντικειμενικό πρόβλημα που υπάρχει εδώ και τώρα.

Ακόμα και τα AI εργαλεία για την πιστοποίηση αυθεντικότητας φωτογραφιών ή βίντεο, είναι ανεπαρκή. Αρχικά, είναι re-active. Δηλαδή πρέπει πρώτα ένα βίντεο ή μία φωτογραφία να γίνει viral για να το εξετάσουν. Και σε κάθε περίπτωση, μπορούν να δώσουν μόνο μια εκτίμηση για το αν είναι πλαστό ή όχι, δεν προσφέρουν απόλυτη σιγουριά.

Μία ενδεχόμενη λύση σε αυτό το πρόβλημα είναι κάποιου είδους πιστοποιητικό γνησιότητας τη στιγμή της λήψης ενός βίντεο ή μίας φωτογραφίας. Που να αποδεικνύει την ημερομηνία και την τοποθεσία στην οποία ελήφθη το υλικό, και πως δεν έχει δεχτεί περεταίρω τροποποίηση.

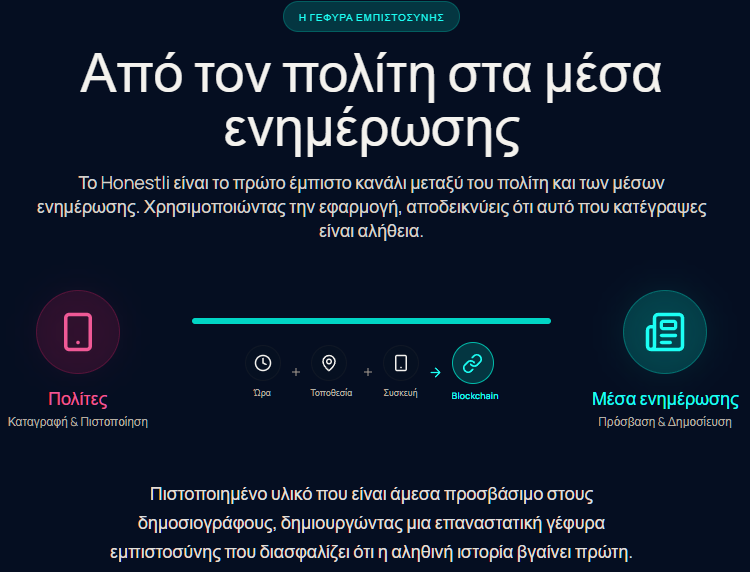

Σε αυτό ακριβώς μπορεί να βοηθήσει η δωρεάν εφαρμογή Honestli, που είναι και ο χορηγός αυτού του άρθρου.

Πώς η Honestli πιστοποιεί την αλήθεια

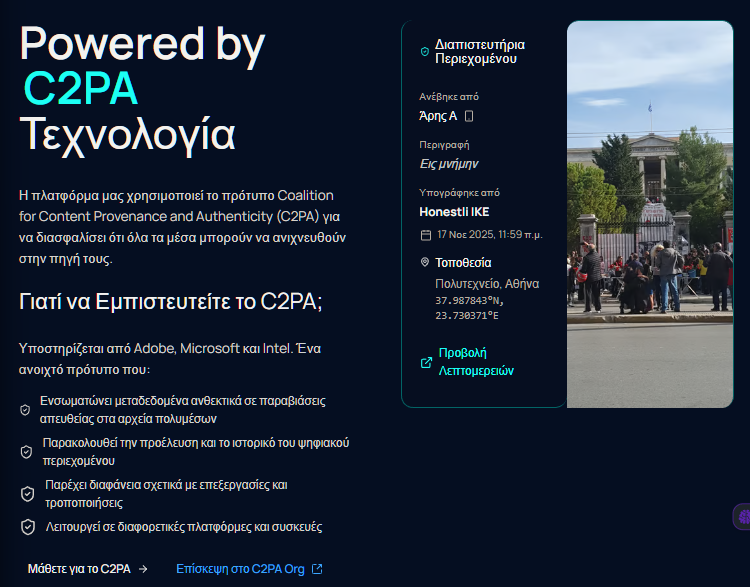

Το σύστημα λειτουργεί ως εξής: όταν τραβάμε μία φωτογραφία ή ένα βίντεο μέσα από την εφαρμογή Honestli, καταγράφονται και ενσωματώνονται σε αυτό ορισμένα μεταδεδομένα, metadata, τα οποία αφορούν την ημερομηνία και την γεωγραφική τοποθεσία.

Δηλαδή οι αποδείξεις πως η λήψη έγινε συγκεκριμένη ημέρα και ώρα, και σε ένα συγκεκριμένο μέρος.

Για τα δεδομένα αυτά, χρησιμοποιείται το C2PA. Πρόκειται για ένα διεθνές standard, σκοπός του οποίου είναι ακριβώς η πιστοποίηση της προέλευσης και της γνησιότητα ψηφιακών αρχείων φωτογραφίας και βίντεο. Ορισμένες από τις μεγαλύτερες και γνωστότερες εταιρείες του κόσμου είναι μέλη του μη-κερδοσκοπικού οργανισμού C2PA.

Από το βίντεο ή τη φωτογραφία που τραβήξαμε, μαζί με τα δεδομένα C2PA, η Honestli δημιουργεί έναν μοναδικό αριθμό hash. Αυτό το κάνει με τη χρήση του ασφαλούς περιβάλλοντος Trusted Execution Environment του κινητού και με μεθόδους κρυπτογραφίας.

Για όσους δεν γνωρίζετε από κρυπτογραφία, το hash είναι ένας μοναδικός αριθμός που προέρχεται από συγκεκριμένα δεδομένα, αλλά που είναι εντελώς αδύνατον από τον αριθμό αυτό να ανακαλύψουμε τα αρχικά δεδομένα. Έτσι το hash χρησιμοποιείται για την πιστοποίηση ευαίσθητων δεδομένων, όπως ας πούμε ένας κωδικός μας σε μια ιστοσελίδα.

Τέλος, αυτό το hash αποθηκεύεται στη βάση δεδομένων της Honestli, μέσω της τεχνολογίας blockchain. Αυτό πιστοποιεί πως μετά την καταγραφή του, είναι αδύνατον να τροποποιηθούν τα δεδομένα του hash από οποιονδήποτε. Ακόμα και από τους ίδιους τους διαχειριστές της Honestli που έχουν πλήρη πρόσβαση στο σύστημα.

Τώρα, αν άκουσες για blockchain και νομίζεις πως η εφαρμογή θα αρχίσει να σου πουλάει κρυπτονομίσματα, βάστα τα κυβικά σου. Απλά χρησιμοποιεί την τεχνολογία της blockchain ως έναν αμετάβλητο τρόπο καταγραφής πληροφοριών. Θα μιλήσουμε λίγο αργότερα για το πώς βγάζει κέρδος η εφαρμογή.

Τονίζουμε επίσης πως μόνο το κρυπτογραφικό hash αποστέλλεται στην Honestli, όχι ολόκληρη η φωτογραφία ή το βίντεο. Και, εξ ορισμού, είναι αδύνατον από το hash να αναπαραχθεί η αρχική φωτογραφία ή το βίντεο. Ή ακόμα και μέρος αυτών.

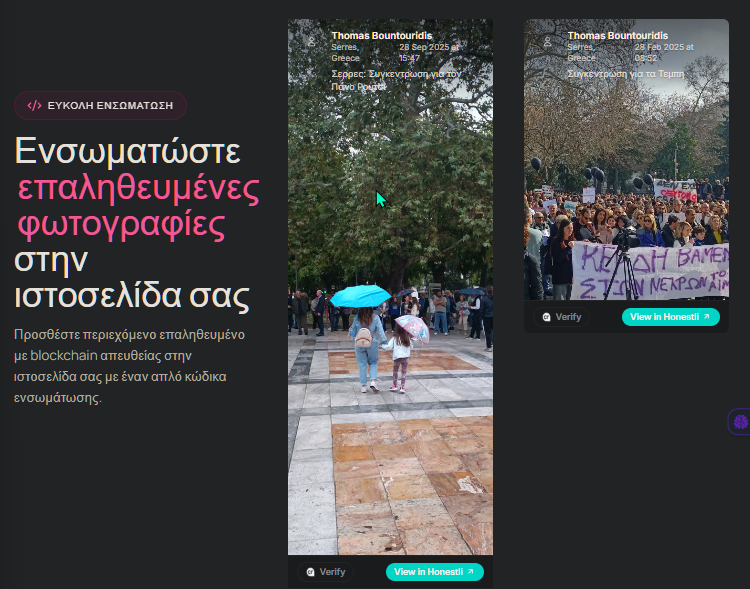

Τέλος, για την πιστοποίηση της γνησιότητας μίας φωτογραφίας ή βίντεο που έχει ληφθεί με την εφαρμογή, ο χρήστης θα πρέπει να ανεβάσει το υλικό στην πλατφόρμα της Honestli. Η υπηρεσία θα εξετάσει αν το hash του υλικού που ανεβαίνει αντιστοιχεί με το hash που είναι αποθηκευμένο στη blockchain.

Αν το αρχείο έχει υποστεί οποιαδήποτε τροποποίηση, ακόμα κι αν έχει αλλάξει ένα και μοναδικό bit στο αρχείο, θα έχει διαφορετικό hash. Και εφόσον δεν θα αντιστοιχεί σε ένα υπάρχον hash στη blockchain της Honestli, το αρχείο δεν θα γίνει αποδεκτό ως έγκυρο.

Το σημαντικότερο είναι πως αρχεία που έχουν δημιουργηθεί με AI, δεν θα διαθέτουν τα αντίστοιχα μεταδεδομένα C2PA. Και αν κάποιος επιχειρήσει να πλαστογραφήσει τα μεταδεδομένα, είναι αδύνατον για το τελικό αρχείο να έχει ένα έγκυρο hash που να είναι το ίδιο με ενός γνήσιου αρχείου.

Να τονίσουμε πως η εφαρμογή Honestli είναι δωρεάν στη χρήση για οποιονδήποτε χρήστη και δημοσιογράφο, και χωρίς ούτε μία διαφήμιση.

Πώς βγάζει λοιπόν χρήματα η εφαρμογή; Τα μέσα μαζικής ενημέρωσης θα πληρώνουν μία συνδρομή στην Honestli.

Με αυτή τη συνδρομή, θα μπορούν να χρησιμοποιήσουν το υλικό που έχουν επιλέξει οι χρήστες να ανεβάσουν στην πλατφόρμα της Honestli. Που τονίζουμε πως είναι μια ενέργεια που θα πρέπει επί τούτου να κάνουν οι χρήστες, δεν αφορά ΟΛΕΣ τις φωτογραφίες και βίντεο που λαμβάνονται μέσω της εφαρμογής.

Με άλλα λόγια, τα media πλέον μπορούν να έχουν πρόσβαση σε αξιόπιστη, άμεση, και ευρεία ροή πληροφορίας, με υλικό που έχει ληφθεί από χρήστες και δημοσιογράφους, που να είναι πιστοποιημένο ως προς τη γνησιότητά του.

Η Honestli έχει ήδη υπογράψει letters of interest σε Ελλάδα, Βουλγαρία, και Κύπρο. Και έχουν ενδιαφερθεί μεγάλα media groups για στρατηγική συνεργασία.

Αν λοιπόν σε ενδιαφέρει η λήψη βίντεο και φωτογραφιών που να μην υπάρχει καμία απολύτως αμφιβολία για τη γνησιότητά τους, κατέβασε την εφαρμογή της Honestli. Ή κάνοντας αναζήτηση στο app store που χρησιμοποιείς, φροντίζοντας η λέξη Honestli να τελειώνει σε i.

Είναι αληθινός ο κίνδυνος του ΑΙ;

Αν σας γεννήθηκαν απορίες, μπορείτε να μας γράψετε στις Ερωτήσεις. Εναλλακτικά, αν θέλετε να μοιραστείτε την άποψη σας για το θέμα, μπορείτε να μας γράψετε στα σχόλια στο σχετικό post του άρθρου στη σελίδα μας στο Facebook.